W roku 2016 firma Google wprowadziła 1653 wdrożenia w wynikach wyszukiwania. Jako że interfejs wyszukiwarki jest niezwykle stały, można przyjąć, że większość z nich dotyczyła backendu. Nawet jeśli tylko połowa tej liczby miała cokolwiek wspólnego z algorytmami ustalającymi kolejność wyników wyszukiwania, daje to średnio ponad 2 aktualizacje dziennie. To wartość spójna z oficjalnym stanowiskiem pracowników korporacji, którzy mówią o 2-3 zmianach dziennie.

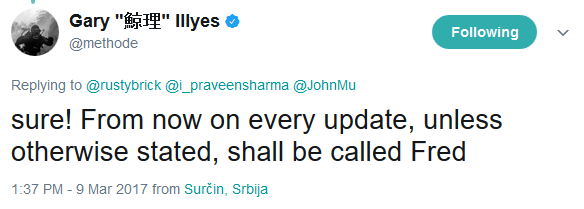

Zatem od marcowych narodzin Freda powinno dojść do 238-357 aktualizacji Fred.

Nawet legenda wiary w każde słowo pracowników Google, Barry Schwartz z Seroundtable.com, przyznał ostatnio ze zrezygnowaniem, że w najnowszej aktualizacji „nie było absolutnie żadnego wzorca”.

Współczesne aktualizacje algorytmiczne

Czasy transparentności firmy Google w zakresie algorytmów już dawno minęły. Informacja o aktualizacji Pingwin z września 2016 była wyjątkowo szczodra, ale była też jedynym takim ogłoszeniem w ciągu ostatnich dwóch lat. Poprzedni oficjalny post, z kwietnia 2015, dotyczył wprowadzenia algorytmu oceniającego przyjazność strony dla użytkowników mobilnych, lecz jego wpływ został zanegowany. Jeszcze wcześniejsza oficjalna informacja pochodzi z sierpnia 2014 i ogłasza algorytm, który promuje strony z protokołem HTTPS, lecz sami pracownicy Google na niedawnej konferencji SMX podważyli bonus wynikający z przejścia na HTTPS. Te krótkie kalendarium pokazuje, że nawet sama firma Google nie podchodzi poważnie do dyskusji o aktualizacjach poszczególnych algorytmów.

Motywem przewodnim bardziej i mniej oficjalnych komunikatów stało się słowo „core” (pol. rdzeń, jądro). Algorytm Panda został włączony do „core”. Algorytm Pingwin został włączony do „core”. Jeśli ktoś pyta pracowników Google o większe zmiany w wynikach wyszukiwania, oprócz żartobliwego Freda zazwyczaj pada informacja o zmianach dotyczących „core”.

To jasna konsekwencja mianowania Johna Giannandrea’i, wybitnego specjalisty w dziedzinie machine learningu, na szefa wyszukiwarki Google. Niedługo minie już 1,5 roku jego pracy na tym stanowisku. Pracy, która de facto polega na transformacji starych kosztownych algorytmów (wymagających wkładu 25 tysięcy wysokoopłacanych inżynierów, m.in. w postaci aktualizacji) w samodzielne, czasem nawet uczące się algorytmy, które można wrzucić do worka „core” (które wymagają… o tym niżej).

Machine learning w SEO w przeciwieństwie do Freda nie jest żartem

Algorytmy trafiające do „core” to naprawdę poważne, długofalowe zmiany.

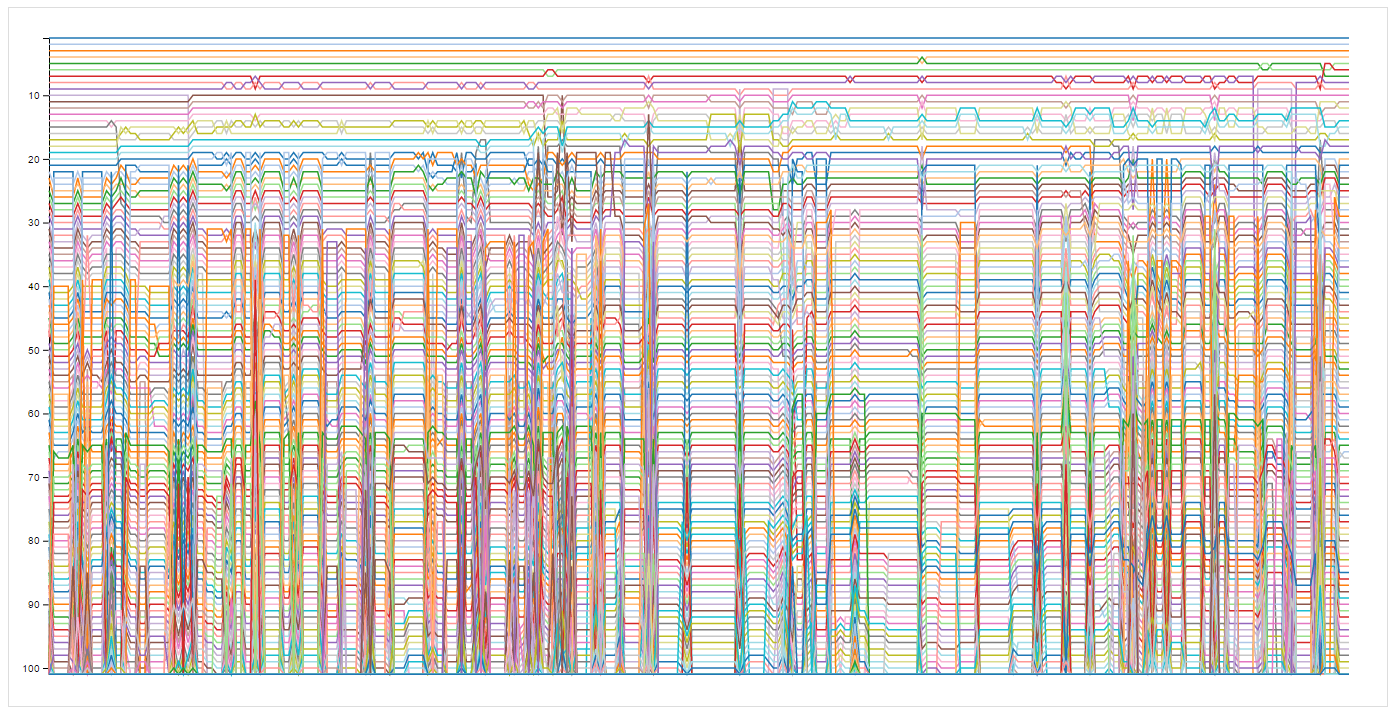

Od roku w każdym miesiącu obserwujemy istotne wahania pozycji, które przypominają znane sprzed dekady Google Dance – tylko w znacznie wyższej częstotliwości. Oczywiście nadal rozkładamy je na czynniki pierwsze, dzięki bardzo dużej próbce (Barry Schwartz analizował wahania z 24-25 czerwca na podstawie 70 domen, natomiast my sięgnęliśmy do porównań statystycznych w obrębie prawie 200 tysięcy monitorowanych domen oraz do izolowanych testów na kilkuset własnych domenach), ale już ciężko mówić o nich per aktualizacja. Wyliczenie sprzed paru akapitów i ostatnie prześmiewcze odpowiedzi pracowników Google mówią same za siebie. Pytasz czy była aktualizacja? Była! I jeszcze będzie dzisiaj druga. A jutro dwie lub trzy kolejne.

Aż w końcu John Mueller stracił cierpliwość i wytłumaczył, że to nie działa na tej zasadzie:

Z naszego punktu widzenia nie było aktualizacji Fred. To nazwa przypisana zewnętrznie do wielu aktualizacji, których dokonaliśmy w ostatnim czasie. Nie polegały na tym, że zmienialiśmy jedną konkretną rzecz w wyszukiwarce, ponieważ zmieniamy wiele przez cały czasy i ciągle szukamy sposobów by prezentować treść o wyższej trafności i wyższej jakości dla użytkowników. To może wpływać na część stron i różnorodne obszary wyników wyszukiwania.

Niełatwo jest rozmawiać o algorytmach „core” nie tylko dlatego, że trudno znaleźć wystarczająco dokładne polskie tłumaczenie (rdzeniowe? jądrowe? główne?), ale przede wszystkim z powodu niewielu oficjalnych komunikatów dostępnych na ich temat. Pracownik Google Andriej Lipatsew sprecyzował, że transformacja w „core” jest etykietą samodzielności algorytmu. Samodzielność w kontekście algorytmów trudno inaczej zdefiniować niż brak konieczności ręcznego poprawiania, a w świecie ciągle zmieniających się wyników wyszukiwania, brak tej konieczności oznacza, że algorytm jest w stanie samodzielnie poprawiać swoje funkcjonowanie – i tu dochodzimy do machine learning.

Niesamodzielność samodzielnego

algorytmu

Oczywiście to nie jest tak, że machine learning to doskonały mózg zamknięty w procesorze (choć takie rendery najczęściej towarzyszą artykułom o RankBrain i innych…), który na podstawie wewnętrznego dumania poprawia swoje funkcjonowanie. Algorytmy ML potrzebują ogromnej ilości skategoryzowanych danych. To w nich odnajdują wzorce, które służą potem do ustalania kolejności wyników wyszukiwania. W firmie Google tych danych dostarczają dziesiątki tysięcy google raterów (walidatorów, „oceniaczy”).

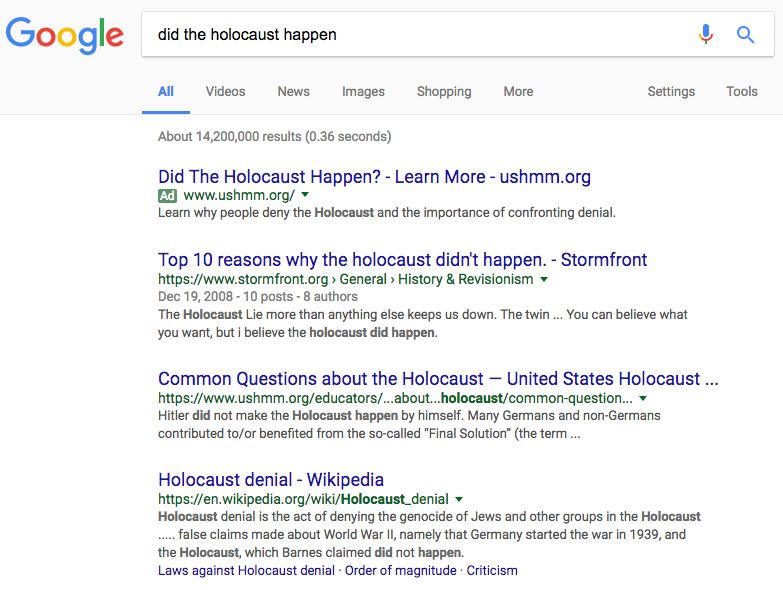

W ostatnich miesiącach wiele mówiło się o google raterach. Czołowe media zwróciły uwagę, że wyszukiwarka Google prezentuje niepokojące wyniki wyszukiwania, na przykład:

Firma Google pod groźbą wycofania się dużych reklamodawców z jej programów, zatrudniła dodatkowe 10 tysięcy raterów.

Jednocześnie pojawiły się reportaże, w których zwrócono uwagę na znacznie głębsze problemy:

„Nie mówię że to cała przyczyna aktualnego kryzysu” – mówi były google rater – „ale wierzę, że niestabilność naszego programu jest czynnikiem. My, raterzy, trenujemy AI, ale dobrze wiemy, że ludzkie oczy i ludzkie mózgi potrzebują czasu na ocenienie treści.” (…) Raterzy mówią, że ich organizacja pracy priorytetyzuje objętość i szybkość, a nie dokładność. W niektórych przypadkach są proszeni o ocenę wielogodzinnnych filmów w mniej niż dwie minuty. Na anonimowych forach, raterzy wymieniają się technikami, które oszczędzają czas – na przykład szukanie tekstów ocenianych piosenek w filmie lub przeskakiwanie każdych 10 sekund klipu. (…) Wielu raterów jest proszonych o oglądanie filmów z szokującą treścią. „Drastyczna treść staje się coraz bardziej drastyczna… osoba popełniająca samobójstwo ze swoim psem w pojeździe, podpaliła samochód i zastrzeliła się. Na anonimowych forach mowa jest o ocenianiu treści z przemocą wobec kobiet, dzieci i zwierząt. Wiele osób pisze, że potrzebują przerwy po obejrzeniu kilku takich filmów z rzędu.”

Jeśli faktycznie dane dla algorytmów są dostarczane w warunkach, które nie cenią jakości, jaki to ma wpływ na same algorytmy? Firma Google zaczęła mieć poważny (= kosztowny) problem z nieodpowiednimi treściami w jej produktach i podjęła w tym kierunku głośne działania. Analogiczny problem z pozostałymi algorytmami ustalającymi kolejność wyników wyszukiwania niekoniecznie musi być poważnym (= kosztownym) problemem z punktu widzenia monopolisty. Czy codzienny Google Dance jest konsekwencją uczenia ML na danych o niskiej jakości? Jakkolwiek to daleko posunięte pytanie, nie tylko my widzimy potężne wahania w wynikach wyszukiwania:

Moratorium na słowo „aktualizacja”? Jeszcze nie, ale…

Polski termin „aktualizacja algorytmu” zdecydowanie bardziej pasuje już nie tyle do angielskiego „update” co do „refresh”. Firma Google nigdy nie zdradzi aż tak głębokich szczegółów, więc już na zawsze pozostanie to w sferze spekulacji, ale można śmiało zaryzykować stwierdzenie (a nawet obserwację), że do istotnej części wahań dochodzi cyklicznie. Internet jest ogromny nawet na miarę niesamowitej infrastruktury Google ze specjalnie stworzonymi jednostkami TPU, i bardziej skomplikowane obliczenia mogą wymagać tygodni do przeprocesowania. Reakcje rozciągnięte do skali tygodni obserwujemy zarówno w przypadku pozyskiwania nowych linków, jak i nawet przy prozaicznych przekierowaniach starej domeny na nową. Jaki jest sens nazywać kilkutygodniowe obliczenia aktualizacją? A już szczególnie aktualizacją Fred? 🙂

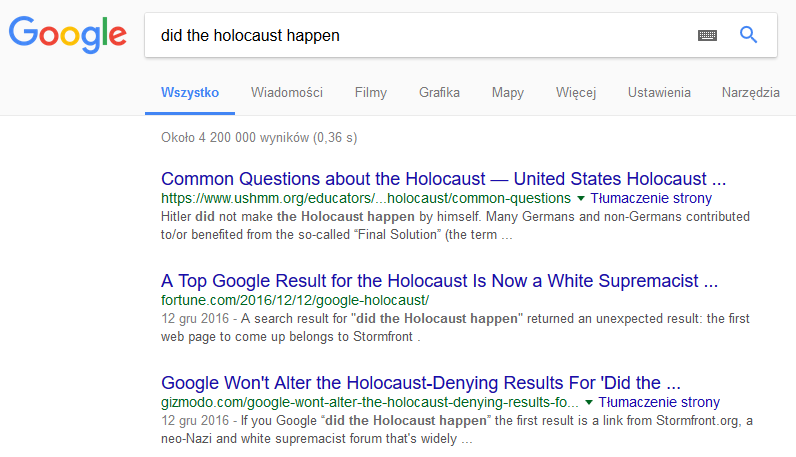

Na koniec nie może zabraknąć pozytywnego akcentu, czyli aktualnego wyglądu wyżej wskazanego zapytania:

Źródła grafik: Twitter, IndianExpress.com, Google.com, Strategiq.co. Zalinkowane źródła: Twitter.com, Google.com, Seroundtable.com, Nprofit.net, TheSEMPost.com, SearchEngineLand.com, Gadgets.ndtv.com, Wired.com.

9 komentarzy

Paweł

Ciężkie czasy dla pozycjonerów, ale gorzej już chyba być nie może 🙂

Marek

Wszystko to prawda, problem jest jeden, zasygnalizowałeś go, AI wyszukiwarki jest nieprecyzyjne, a „stare” algorytmy działały naprawdę lepiej. – Wie to każdy śledzący wyniki od kilkunastu lat. Można powiedzieć, że AI się nauczy i będzie pięknie, tylko że wiele wskazuje na dwa fakty – wszem wprowadza się automatyczne inteligentne algorytmy, ale podobnie jak z „raterami” upraszcza się je… Droga donikąd…

Widoczni

Dlatego właśnie lepiej wziąć się do roboty, bo jest jej coraz więcej, zamiast śledzić każdą wypowiedź pracowników Wujka Googla 🙂

Jacek

Jak wpisuję w google: „did holocaust happen” na pierwszym miejscu pojawia się strona „Top 10 reasons why the holocaust didn’t happen. – Stormfront” :/ Zatem nie zauważam żadnej pozytywnej zmiany.

Rafał Grochala

Faktycznie! Zmieniły się wyniki dla „did the holocaust happen”, a dla „did holocaust happen” pozostały te same.

Mariusz Kołacz

Wszystko idzie w dobrym kierunku, oby tak dalej.

Grzesiek

Bardzo dobry artykuł 🙂 Cykliczne zmiany zaczęły się odkąd Google ogłosiło aktualizację Pingwina w czasie rzeczywistym. Od tego czasu co kilka tygodni widać okres kilku dni gdzie wyniki skaczą. Jest duże prawdopodobieństwo że te cykliczne zmiany to właśnie Pingwin w „czasie rzeczywistym” który co kilka tygodni przelicza i wdraża zebrane dane.

reklamy-arek

Jako laik chcę zapytać, czy wykresy Alexa pokrywają się choć częściowo ?

Rafał

Z tego co twierdzi Google to aktualizacje algorytmu odbywają się w każdym tygodniu. Generalnie artykuł bardzo fajny.