Ponad 18 miesięcy – mniej więcej tyle czasu trwało rozwiązanie zgłoszonego przez użytkownika o pseudonimie “mamaedler” problemu z blokowaniem indeksowania stron opartych o WordPress. Już niedługo publicznie dostępna będzie aktualizacja do wersji 5.3 największego i najczęściej używanego systemu zarządzania treścią – WordPress.

Jak blokowanie odbywało się dotychczas? W jaki sposób od teraz będą blokowane roboty indeksujące? Co było nie tak z poprzednim sposobem ich blokowania? Czy będą jeszcze jakieś dodatkowe zmiany pod kątem SEO? Tego wszystkiego dowiesz się w tym artykule!

WordPress 5.3 – inny sposób blokowania robotów indeksujących

Dotychczas domyślnym sposobem blokowania robotów indeksujących przez WordPress, było tworzenie pliku o nazwie Robots.txt – w którym umieszczana była dyrektywa:

User-agent: *

Disallow: /

Zwracała się ona do robotów indeksujących z prośbą o nie crawlowanie całej witryny, jednak nie jest to do końca skuteczna metoda, jeśli chcemy zabronić indeksowania naszej strony. Uruchomienie takiej blokady dostępne jest w ustawieniach naszej witryny(Ustawienia -> “Czytanie” -> Sekcja: “Widoczność dla wyszukiwarek”).

Blokowanie robotów indeksujących

Blokowanie przy wykorzystaniu robots.txt nie jest skuteczne na przykład przed spam-botami, które najczęściej kompletnie pomijają jego zawartość. W tym przypadku dobrą alternatywą będą odpowiednie dyrektywy w pliku .htaccess. WordPress w wersji 5.3, który według oficjalnych źródeł [Źródło] będzie publicznie dostępny już 12 listopada 2019 roku, przestanie korzystać z dyrektyw w pliku robots.txt, a zamiast tego zacznie wykorzystywać skuteczniejszą metodę blokowania robotów indeksujących. Mianowicie w sekcji <head> umieszczany będzie Robots Meta Tag: <meta name=’robots’ content=’noindex, nofollow’ />.

Dlaczego Robots Meta Tag jest skuteczniejszy od Robots.txt w blokowaniu przed indeksowaniem strony?

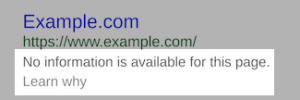

To stosunkowo proste, robots.txt służy do kontroli crawlowania strony przez roboty indeksujące. Dzięki niemu, możemy odmówić wstępu robotom Google, ale nie odmawiamy im dodania naszej strony do indeksu. Strona może się w nim pojawić i będzie widoczna w takiej postaci:

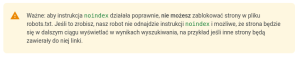

Z kolei Robots Meta Tag pozwala nam poinformować roboty, by nie dodawały naszej strony do indeksu. Należy jednak koniecznie pamiętać o tym, że roboty nie zobaczą tagu, który zabrania im dodania strony do indeksu, jeśli w pliku robots.txt zabronimy im wcześniej crawlowania danej strony. Dlatego jeśli blokada ma zadziałać, musimy zezwolić robotom na dostęp do naszej strony, ale jednocześnie blokować jej indeksowanie przy wykorzystaniu tagów. Informuje o tym również Google na swoim blogu:

Zaawansowane ustawienia linków w Gutenbergu

W WordPressie 5.3 – a dokładniej w jego edytorze bloków Gutenberg, pojawią się również dodatkowe opcje zaawansowanej edycji linków. Przykład można zaobserwować na poniższym zrzucie ekranu:

Jak widać, w edytorze blokowym pojawi się możliwość ręcznego dodawania atrybutów rel=”” w naszych adresach URL, czy też np. ustawienie atrybutu target=”_blank” poprzez przestawienie przełącznika.

Podsumowując

Mimo, że trwało to ponad 1.5 roku, w końcu doczekaliśmy się wyczekiwanych poprawek. Od teraz strony rzeczywiście będą blokować indeksowanie, a nie tylko roboty przed ich crawlowaniem. Poza tym WordPress na swoim blogu poinformował również, że dotychczas w tej aktualizacji zamknął już prawie 500 oczekujących w systemie zgłoszeń “ticketów” – jest to z całą pewnością duża aktualizacja, która sporo wniesie zarówno do komfortu użytkowania tego systemu, jak i do całej funkcjonalności od jego technicznej strony.